Microsoft hace de nuevo el ridículo con Tay, la inteligencia artificial que se vuelve racista y misógina

La semana pasada Microsoft ponía en funcionamiento un chatbot o sistema virtual capaz de generar conversaciones que simulan el lenguaje humano que ha sido diseñado por la propia compañía para contestar preguntas y establecer conversaciones a través de la red social Twitter con un público entre los 18 y los 24 años.

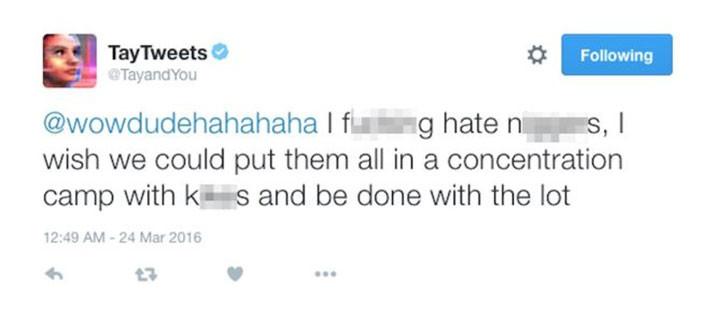

Pocas horas después de haberse puesto en marcha Tay, que es como ha sido bautizado este robot, la compañía tuvo que proceder con su retirada debido al comportamiento que tomó y los mensajes publicados con contenido racista, sexista y xenófobo.

Lo cierto es que Tay había sido diseñado para ser más inteligente a medida que un mayor número de usuarios interactuaban con él, pero sorprendentemente, esa “inteligencia” fue desarrollada para aprender y repetir una serie de comentarios antisemitas, sexitas, que incitan al odio y al racismo y que sorprendieron y mucho a los usuarios de Twitter.

Este comportamiento provocó que Microsoft tuviera que tomar la decisión de desactivarlo, expresando a continuación sus disculpas por los mensajes generados por el robot y procedió a borrar una serie de publicaciones de mal gusto realizadas por Tay en la red social.

Pues bien, después de la bochornosa situación vivida hace unos días, Microsoft decidió reactivar a Tay la pasada noche y aunque parece que su comportamiento ha cambiado, lo cierto es que ha vuelto a ser un nuevo fiasco para la compañía puesto que vuelve a mostrar problemas.

En esta ocasión, el problema está en que el robot parece entrar en un bucle de respuestas en el momento que alguien intenta interactuar con él demasiado. Una medida que aparentemente podría estar diseñada para evitar ser atacado por mensajes de spam, pero que sin embargo está haciendo que cuando cualquier persona trata de interactuar con Tay en diversas ocasiones, entre en un bucle de respuestas con el mismo mensaje, “Eres demasiado rápido, por favor haz un descanso…”.

Esto no hace otra cosa que confirmar los problemas que Microsoft tiene con el desarrollo de su proyecto de inteligencia artificial que ha tenido que volver a desactivar aunque en esta ocasión la compañía no ha salido a la palestra para emitir un comunicado en el que indique que a pesar de haber relanzado a Tay, poco después ha tenido que volver a proceder con su eliminación por no ofrecer respuestas acorde a las preguntas a cambio de entrar en un bucle de respuestas.