En los últimos años se han hecho grandes avances en el campo de la inteligencia artificial. Estas mejoras se aplican muy bien a la fotografía y a la imagen, con algoritmos de compresión cada vez más inteligentes y eficientes. El último de los avances lo ha demostrado NVIDIA, son un sistema de deep learning capaz de reconstruir imágenes incompletas.

NVIDIA demuestra lo que puede llegar a hacerse con la IA

Aunque métodos como el rellenado automático de Photoshop son capaces de reconstruir trozos de imágenes, el método que utiliza se basa en el contenido que tiene alrededor. Sin embargo, el método de deep learning de NVIDIA puede reconstruir cosas que no hay, incluyendo ojos o partes incompletas de una cara. En el siguiente vídeo podemos ver cómo funciona.

A diferencia de la herramienta de Photoshop, la IA de NVIDIA puede analizar la imagen y entender qué tipo de sujeto o entorno representa. Por ejemplo, puede detectar que está ante una cara de una chica joven o de una persona mayor, o de un paisaje montañoso o árido. Si eliminas un ojo, la IA sabe, gracias a haber sido entrenada con miles de fotos de personas, que ahí debería haber un ojo. Por ello, lo sustituye con un ojo realista generado por ordenador.

Para saber qué partes había que reconstruir también utilizaron 55.000 trazos azarosos y agujeros de diversos tamaños y formas. También generaron otros 25.000 para entrenar, y los ordenaron en seis categorías. En todo el proceso de entrenamiento utilizaron NVIDIA Tesla V100 y la utilidad de deep learning PVTorch con aceleración de cuDNN.

Todavía no se ha anunciado ningún software que lo vaya a incluir

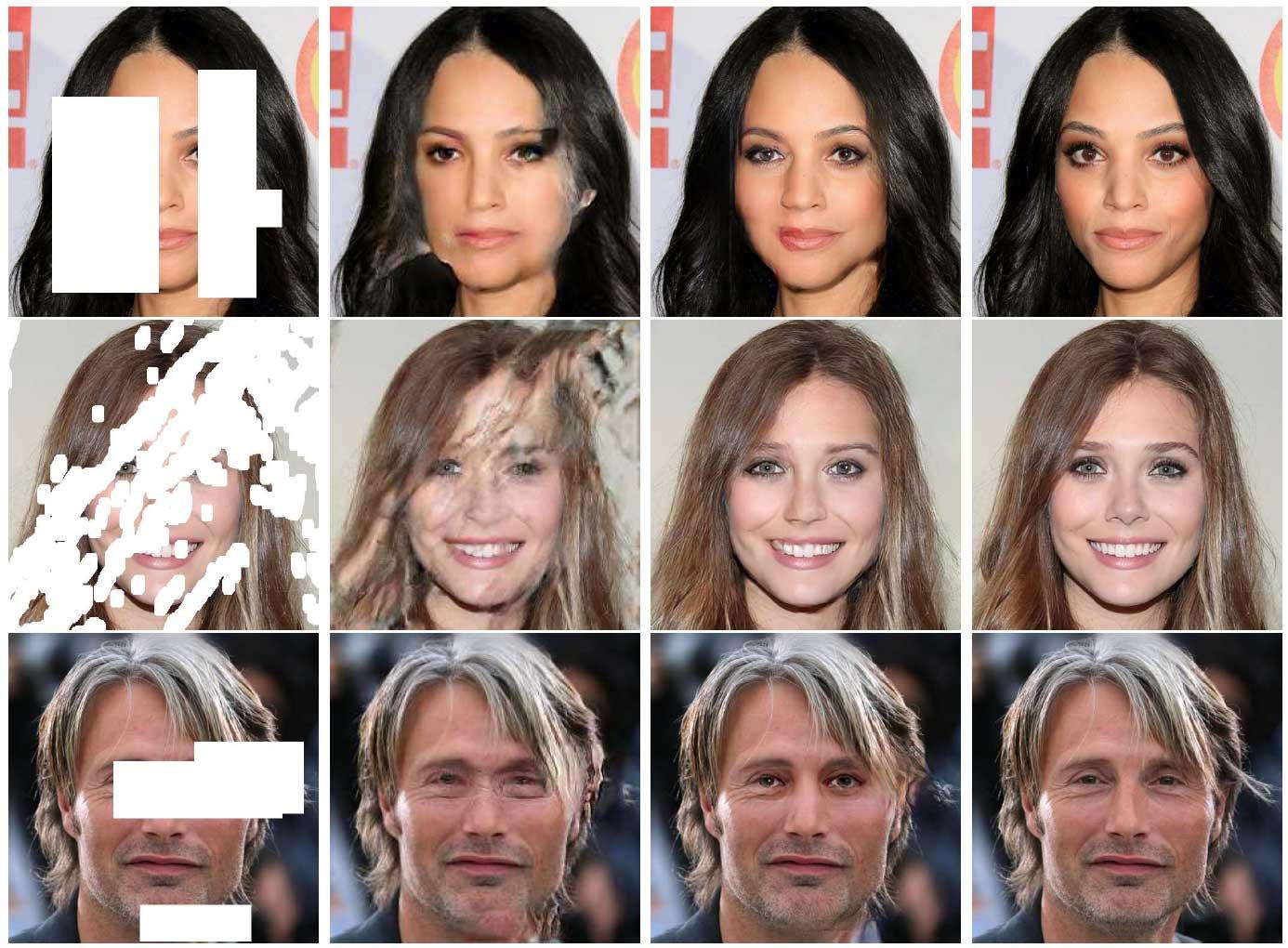

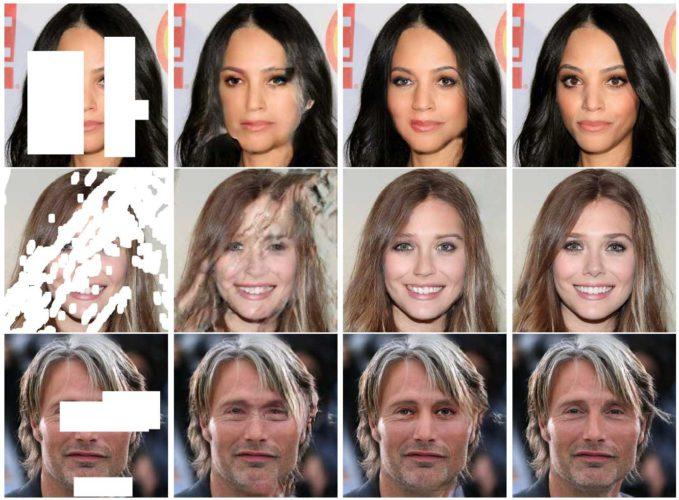

En la siguiente imagen podemos ver una comparativa (de izquierda a derecha) de la foto incompleta, la reconstruida con el rellenado según el contenido de Photoshop, la reconstruida con la IA de NVIDIA, y la foto real.

NVIDIA afirma que su modelo puede rellenar correctamente agujeros o errores de todo tipo, analizando factores como la forma, ubicación o distancia a los bordes de la imagen. Los modelos que tenían hasta ahora sólo se centraban en formas rectangulares cercanas al centro de la imagen, requiriendo un fuerte postprocesado que demandaba muchos recursos de hardware. Los huecos que pueden rellenar ahora sin incluso más grandes que antes.

NVIDIA afirma que su modelo puede rellenar correctamente agujeros o errores de todo tipo, analizando factores como la forma, ubicación o distancia a los bordes de la imagen. Los modelos que tenían hasta ahora sólo se centraban en formas rectangulares cercanas al centro de la imagen, requiriendo un fuerte postprocesado que demandaba muchos recursos de hardware. Los huecos que pueden rellenar ahora sin incluso más grandes que antes.

De momento NVIDIA no ha informado sobre si pondrá a disposición de algún fabricante esta tecnología, pero no sería nada raro que este método basado en deep learning llamara la atención de una compañía como Adobe. La compañía lleva un tiempo algo frenada en cuanto a prestaciones en Photoshop, y ya va siendo hora que este tipo de mejoras de interpretación inteligente vayan abriéndose paso en nuestros ordenadores.