El deep learning y la IA ha hecho, en los últimos años, que tengamos que dudar cada vez más del contenido que vemos. Es relativamente asequible para cualquier persona sustituir la cara de otra en una foto, o incluso en un vídeo, así como generar nuevas caras de personas que no existen. Ahora, han conseguido hacer eso, pero con imágenes tomadas por satélite.

Los deepfakes siguen llenando la red, usándose incluso para desnudar a personas vestidas, o generar caras de personas que no existen. La web de https://thispersondoesnotexist.com/ ha mejorado en los últimos años, y ofrece caras cada vez más reales. Ahora, se están viendo los peligros de imágenes de ciudades y campo que pueden ser modificadas para mostrar contenido que en realidad no está ahí.

Los deepfake llegan a los mapas

Los geógrafos están preocupados por la proliferación de este tipo de contenido. Por ejemplo, pueden ser usados para crear bulos relacionados con incendios o inundaciones, o para decir que un país tiene un campo de concentración cuando en realidad no lo tiene. El ejército de Estados Unidos ya alertó sobre esto en 2019, donde un software militar puede ver un puente en una ubicación errónea, y eso puede afectar al desarrollo de una misión, ya que les pueden tender una trampa al no haber un puente en esa ubicación.

Un grupo de investigadores ha publicado ahora un artículo donde analizan esta problemática, llamado «Deep fake geography? When geospatial data encounter Artificial Intelligence«. Esta investigación es la primera que aplica el concepto de los deepfakes a las imágenes por satélite, y han demostrado que se puede realizar. Con ello, quieren poner en conocimiento de la ciudadanía sus posibles problemas.

Los investigadores afirman que los humanos llevan años mintiendo con mapas, incluyendo límites y márgenes donde no estaban, ocultando islas, poniendo pueblos que no existen o calles que no están realmente ahí. Esto se usaba para identificar a quienes copiasen mapas, y si bien en Google Maps no vamos a encontrarnos cosas así, en alternativas a Maps sí que podemos encontrarnos falsificaciones de contenido si la empresa es controlada por el gobierno, como puede ocurrir en China.

Su IA puede detectarlos, pero irán mejorando

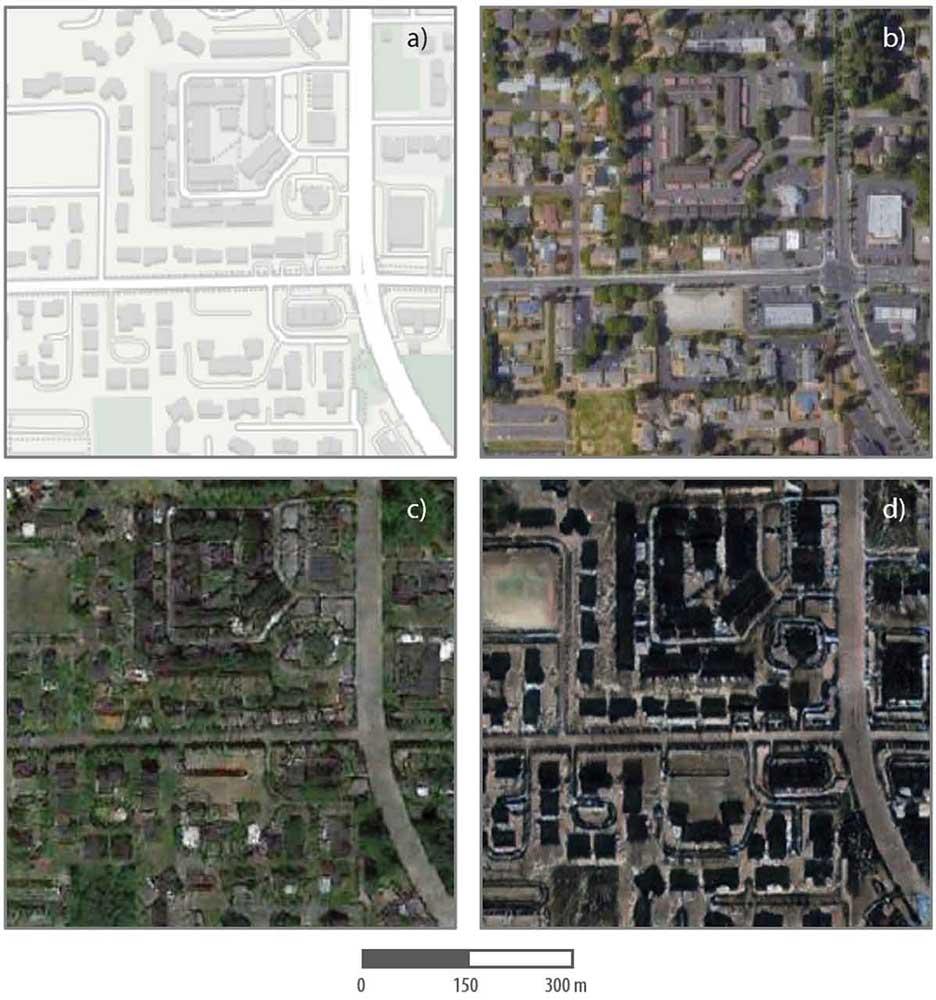

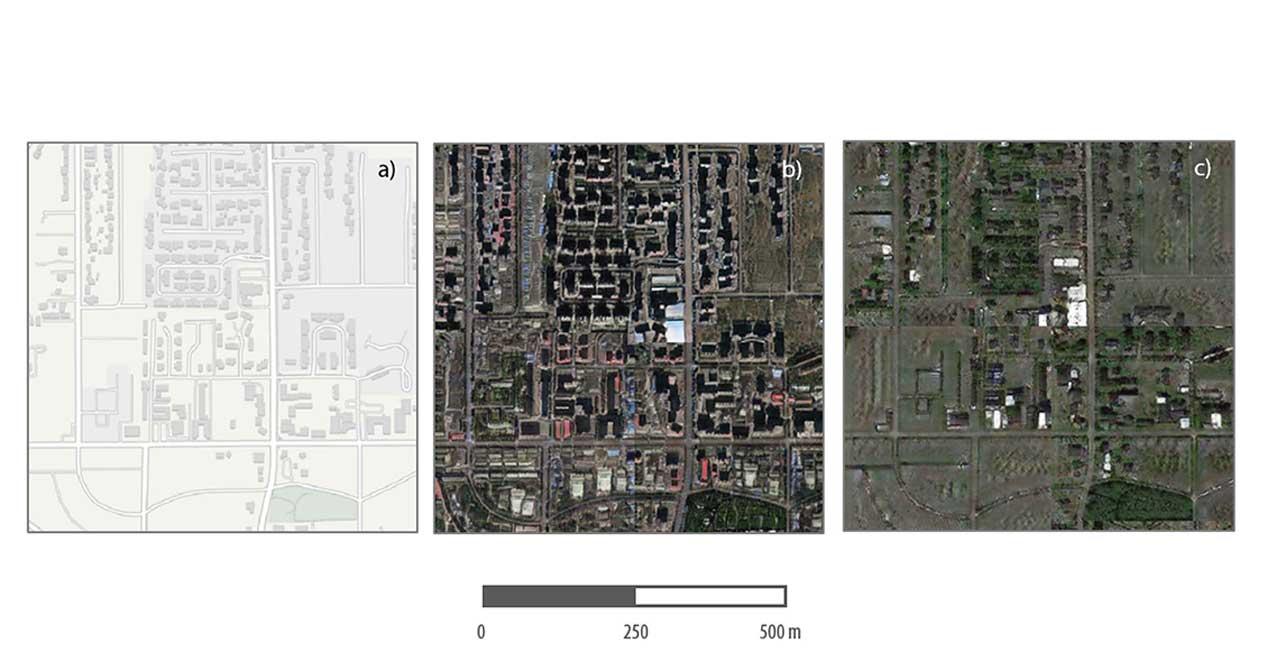

La IA se usa en la actualidad en los mapas para resolver problemas geográficos o identificar elementos, pero poca gente parece haberse dado cuenta de los peligros que entraña. Los investigadores han conseguido generar sitios desde cero por completo que parecen reales, y alguien que no se fije en detalle puede pensar que se trata de sitios reales. Para ello, han usado las Generated Adversarial Networks, o GANs, que usan otros sistemas como la web que genera caras de personas que no existen.

Para entrenarlo, usaron imágenes reales tomadas por satélite de sitios como ciudades. El proceso de entrenamiento no fue sencillo, ya que algunas de las imágenes generadas tenían unas sombras un poco raras.

La baja resolución que tienen las fotos tomadas por satélite ayuda a que se puedan falsificar con relativa facilidad. Con este sistema de detección podían también detectar imágenes falsas analizando detalles como textura, contraste o color. El problema es que estos sistemas necesitan actualizarse constantemente para compensar las constantes mejoras y novedades que se realizan en la generación de deepfakes.