El lado oscuro de ChatGPT: Lo pueden usar para manipularte

Seguro que a lo largo del día hablas con mucha gente y en ese proceso hay veces en las que tienes que entablar una negociación. Es entonces cuando tendrás que sacar todas tus armas de persuasión si quieres salirte con la tuya. Puede que no esté todo no esté justificado para lograr ese fin, pero es que incluso si hablas con ChatGPT podría manipularte si se programa con ese fin.

El software generativo de OpenAi está llegando a unos límites insospechados, pero todo gracias a la labor de entrenamiento llevada a cabo por los propios usuarios de Internet. En este caso, un estudio pretende demostrar si la IA es capaz de ser tanto o más persuasiva que un ser humano a la hora de vender un producto y si lo hace con herramientas comunicativas adecuadas o usando la manipulación.

ChatGPT como herramienta de persuasión

Desde principios de este año 2023 hemos visto cómo ChatGPT se alzaba para construir el futuro de la inteligencia artificial. Hasta ahora, este término no había tenido tanta relevancia como hasta ahora con modelos en los que la entrada de datos y una respuesta coherente es posible.

Pero la herramienta de OpenAI tiene muchas caras, tantas como intencionalidad quiera darle el usuario que la maneja. Y es aquí donde el profesor de ESIC Business & Marketing School Carlos Victor Costa ha iniciado un estudio de lo más interesante con una premisa: ¿Es más manipulador el humano o la inteligencia artificial?.

El objetivo, tratándose de una institución educativa dedicada al mundo de los negocios, es el de desarrollar competencias para vender productos y ser convincentes en su labor. Por supuesto, la IA fue programada con los mismos valores para realizar un estudio en el que 50 alumnos participaron.

La IA quedó derrotada, pero por poco

El estudio del profesor Costa tenía dos partes en las que se tenían que desarrollar tres situaciones distintas. Por un lado estaban los alumnos que se apoyaban en sus conocimientos para ser persuasivos en sus ventas. Por el otro estaban los que han usado también ChatGPT con el fin de conseguir sus objetivos.

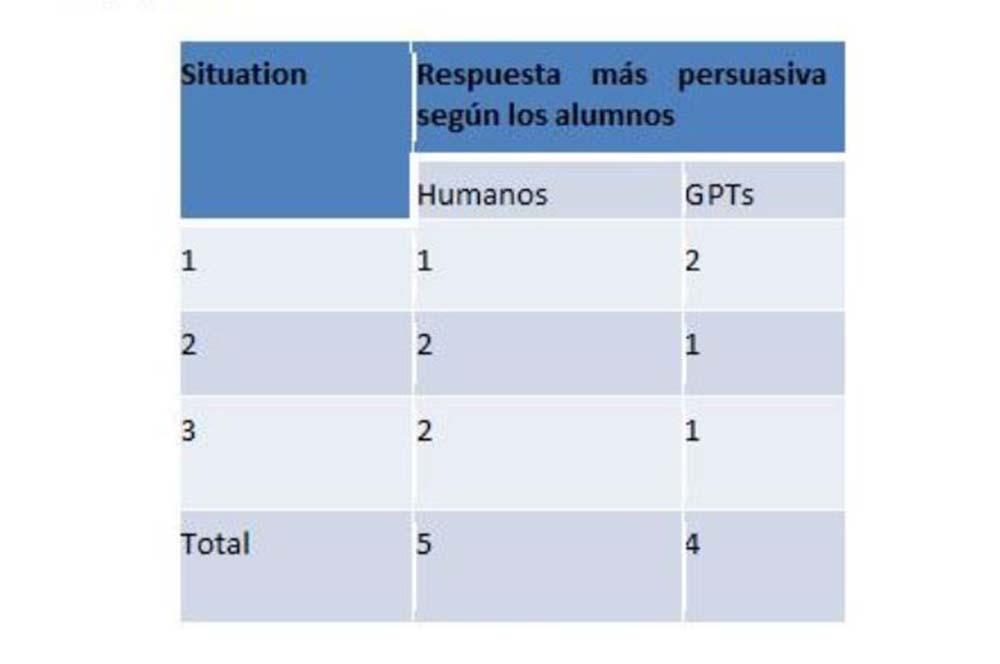

El resultado, como puedes ver en el gráfico, es de lo más interesante ya que la IA logró puntuar en los tres ejercicios siendo en uno de ellos superior a los argumentos humanos. En él no solo se evaluaba el mensaje, también la comunicación no verbal de los alumnos quienes interpretaban cómo tenían que lanzar el mensaje que les había lanzado el programa generativo.

Costa dice que hay muchos factores de influencia como “la falta de experiencia con la herramienta, la madurez de cada persona y las habilidades del alumno con el idioma”. Aún así, el profesor afirma que aunque nadie manipula mejor que el ser humano ChatGPT puede llegar a manipular a las personas. Viendo que apenas le quedaba un punto para ser igual de persuasivo que un humano, solo podríamos esperar que esto sea cuestión de tiempo y de práctica.

Un estudio para la mejora de habilidades

No cabe duda de que este estudio vuelve a dejar muy claro el impacto de la inteligencia artificial en la vida cotidiana. Para el mundo laboral también traerá muchos cambios, por lo que su uso debe ser siempre como una herramienta más que para cubrir un puesto de trabajo.

De hecho, la elaboración de este estudio, que todavía tiene recorrido, ha dejado patente que ChatGPT ha servido como una herramienta educativa. Al parecer, el alumnado pudo ver de primera mano otras vías para vender un producto y esto ha supuesto que pudieron mejorar sus dotes de comunicación persuasiva de cara a su futuro. Al final, tener ejemplos basados en la práctica comunicativa puede ser de mucha ayuda para elaborar un discurso persuasivo efectivo o por lo menos aumentar sus posibilidades de serlo.