NVIDIA presentó el pasado mes de agosto sus nuevas RTX 2070, RTX 2080 y RTX 2080 Ti en la Gamescom 2018. Estas tarjetas gráficas van a ser el nuevo referente de rendimiento, y hoy NVIDIA ha desvelado todos los detalles sobre la arquitectura Turing, ya que durante la Gamescom fue bastante críptica sobre algunas de las novedades tecnológicas.

La NVIDIA RTX 2080 es un 8% mejor que la GTX 1080 Ti

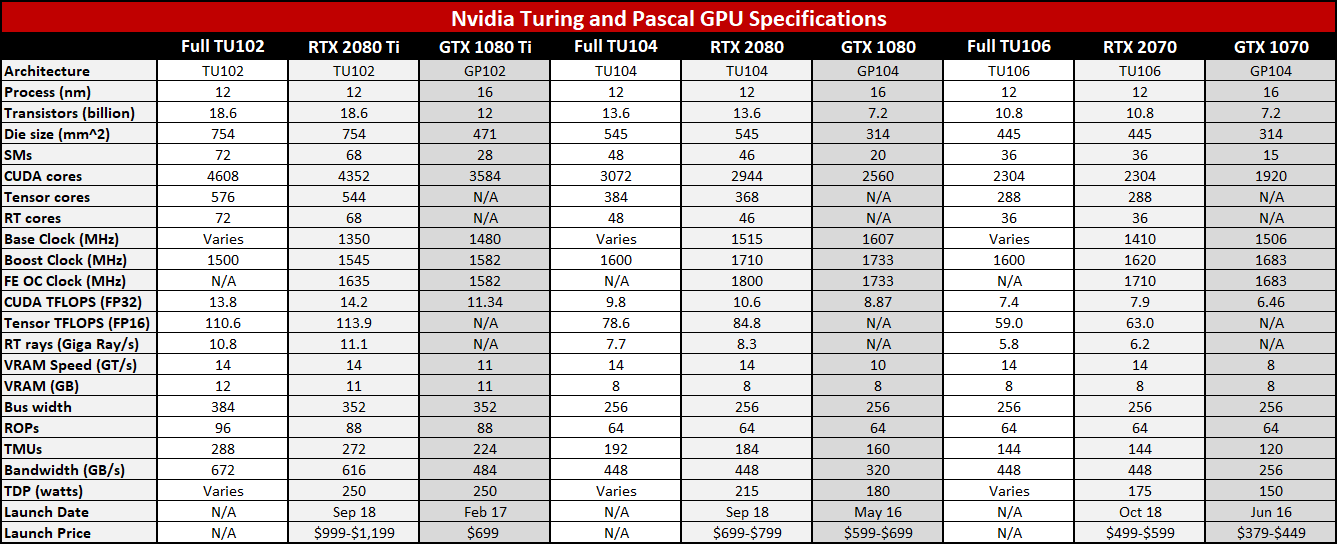

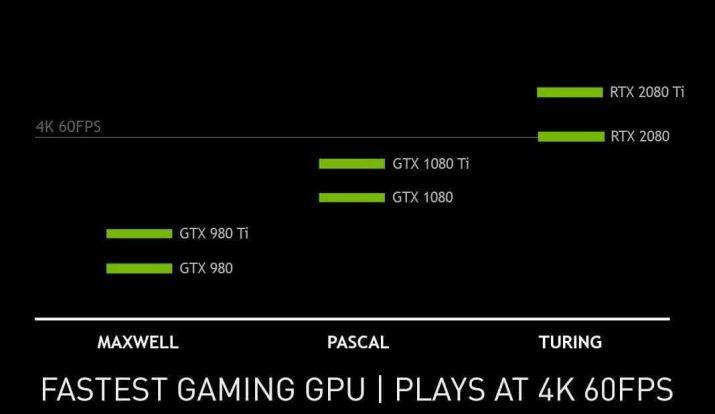

Para conocer el rendimiento de las tarjetas gráficas habrá que esperar todavía al 19 de septiembre, ya que de momento sólo se ha permitido el unboxing y los detalles de la arquitectura. Turing es el mayor salto a nivel de diseño que NVIDIA ha dado en más de una década, ya que en su interior encontramos una gran cantidad de cambios. En cuanto a rendimiento, lo único que se ha confirmado hoy ha sido que la RTX 2080 consigue unos 10.147 puntos en TimeSpy; en torno a un 8% más que la 1080 Ti, gracias a una filtración por haberse lanzado hoy los drivers para los reviewers, con la versión 411.51. En total encontramos tres nuevos chips basados en Turing: TU102, TU104 y TU106, que equipan la 2080 Ti, 2080 y 2070, respectivamente. Sin embargo, cada especificación cambia con cada tarjeta, ya que están recortados; probablemente para lanzar versiones futuras más potentes. Además, en otras generaciones sólo había dos chips en el lanzamiento.

En total encontramos tres nuevos chips basados en Turing: TU102, TU104 y TU106, que equipan la 2080 Ti, 2080 y 2070, respectivamente. Sin embargo, cada especificación cambia con cada tarjeta, ya que están recortados; probablemente para lanzar versiones futuras más potentes. Además, en otras generaciones sólo había dos chips en el lanzamiento.

La arquitectura Turing tiene entre un 15 y un 20% más de CUDA Cores que los modelos equivalentes en Pascal. Además, también se añaden los Tensor Cores y los RT Cores, y más SM. La memoria GDDR6 hace acto de presencia, con 11 GB de VRAM para la 2080 Ti y 2080, y mayor velocidad que GDDR5X.

En el núcleo de la GPU TU102 encontramos seis GPC (Graphics Processing Clusters), con cada uno teniendo seis TPC (Texture Processing Clusters), un motor PolyMorph y un motor de rasterización dedicado. Cada TPC, a su vez, se subdivide en dos SM (Streaming Multiprocessors), los cuales AMD llamada Compute Unit (CU). Cada SM tiene 64 CUDA Cores.

Junto al GPC encontramos 12 controladores de memoria GDDR6 de 32 bits para un total de 384 bits. Los controladores tienen los ROP (Render Output), haciendo que la RTX 2080 Ti tenga 88 ROP. La interfaz usada es PCIe 3.0.

Ray Tracing y Tensor Cores: la principal novedad de las tarjetas

A nivel de arquitectura, como decíamos, hay dos importantes novedades:

Los RT Cores para el raytracing son quizás la más destacable. Cada SM de Turing tiene un RT Core, aunque es difícil determinar la cantidad exacta porque el algoritmo BVH usado no es determinista y no siempre tarda lo mismo. Los RT Cores gestionan hasta 10 Giga Rays por segundo en la RTX 2080 Ti, alcanzando 10 TFLOPS por cada Giga Ray por segundo (son RT TFLOPS, eso sí, destinados a acelerar estos procesos de ray tracing). Con esto, las luces y los reflejos son mucho más fidedignos y reales, aunque su consumo de recursos es muy elevado y hasta que no lleguen futuras tarjetas al mercado muchos usuarios preferirán desactivarlo.

En segundo lugar, los Tensor Cores, que hasta ahora habían sido usados para el machine learning, permiten utilizarlos para diversas mejoras en los juegos. Uno de los más interesantes es el uso de IA para mejorar la calidad de la imagen sin que afecte tanto al rendimiento. Para ello, han trabajado junto con Microsoft para crear la DirectML y Windows ML, donde la API DirectX Machine Learning permite aprovecharse de todo ello. En los próximos años más y más juegos irán soportándolo.

Con el machine learning consiguen un mejor escalado de imágenes, ya que el machine learning se ha entrenado con billones de imágenes para generar fotogramas de más calidad y con menos defectos visuales. Por ejemplo, se puede ejecutar un juego a 1080p a 144 FPS, y con los Tensor Cores hacer un reescalado a 4K con el mismo framerate sin que apenas se vea afectado el rendimiento, con una técnica llamada DLSS (Deep Learning Super Sampling).

Todos estos cambios hacen que sea difícil medir la mejora de rendimiento de manera justa entre las tarjetas basadas en Pascal y Turing. Por ello, han creado la figura de las RTX-OPS, donde los juegos compatibles con DLSS y denoising usarán durante un 80% del tiempo FP32 shading, mientras que durante un 35% usarán INT32 shading, con Ray tracing en un 40% del tiempo, y el procesamiento de imágenes finales con los Tensor Cores un 20%. Con ello, la RTX 2080 Ti alcanza 78 RTX-OPS, por los 11,3 de la GTX 1080 Ti (ya que la cifra es igual al número de TFLOPS normales que puede procesar). Esto no implica que la 2080 sea 7 veces mejor, pero sí que en juegos que aprovechen todas las ventajas de las nuevas tarjetas la diferencia va a ser abismal.

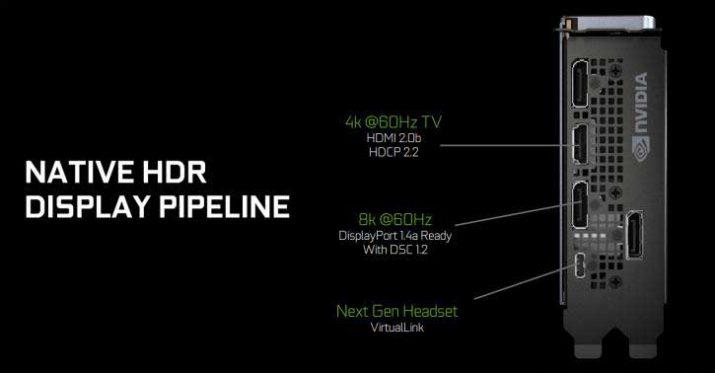

A nivel de reproducción de vídeo, Turing viene preparada para lo mejor, con soporte para codificar HEVC 8K a 30 FPS en tiempo real, además de ser un 25% más eficiente con HEVC y un 15% con H.264. También puede descodificar por hardware VP9 de 10 y 12 bits en HDR, así como HEVC 444 a 10 y 10 bits HDR. Gracias a esto, el impacto en la CPU de la renderización será apenas imperceptible, dejándola libre para otras tareas.

La arquitectura Turing está fabricada usando un proceso de 12 nanómetros FinFET de TSMC. El año que viene AMD usará 7 nanómetros también de TSMC, por lo que habrá que ver si la compañía consigue acercarse a lo que NVIDIA ha conseguido este año. De hecho, NVIDIA podría lanzar una versión revisada de Turing con ese tamaño el año que viene, aunque habrá que ver primero si tienen la necesidad de hacerlo. El overclock será más fácil que nunca gracias al uso de NVIDIA Scanner, el cual permitirá hacerlo con un solo click.

Así, esta arquitectura es una gran apuesta por parte de NVIDIA, que sólo hay que esperar a que empiecen a apoyar los desarrolladores. No sólo el ray tracing puede ser el futuro de los juegos, sino que el uso de IA con los Tensor Cores puede llegar a multiplicar el rendimiento y mejorar el escalado a cifras hasta hora impensables.