Ley Nielsen, o por qué la velocidad de Internet sí puede duplicarse

¿Cada cuánto tiempo aumenta la velocidad de acceso a Internet? Según la Ley de Nielsen, se duplica cada 21 meses. Hablamos, según lo enunciado por Nielsen, de que el ancho de banda crece para los «usuarios avanzados» en menos de dos años. ¿Es cierta esta afirmación? Abordamos el tema y nos centramos en las excepciones, los límites de crecimiento a nivel velocidad.

La evolución de la tecnología se puede encerrar, en cuanto a su ritmo, dentro de varias Leyes. Al menos eso es lo que han pretendido expertos en diferentes materias, quienes han enunciado sus propias teorías al respecto. De hecho, existen cuatro leyes principales que rigen la evolución de la tecnología, y son las siguientes:

- Ley Moore: La potencia de los chips se duplica cada 18 meses.

- Ley Kryder: La capacidad de almacenamiento se duplica cada 12 meses.

- Ley Nielsen: La velocidad de Internet se duplica cada 21 meses.

- Ley Kaku Caveman: Los impulsos primitivos terminarán superando a las aspiraciones modernas. La tecnologíatiende a volverse más natural, efectiva y adecuada a los deseos primitivos.

Tu conexión es de 10 Mb y lleva siendo así más de 3 años. De acuerdo, pero estas situaciones «particulares» -que de particulares tienen poco- no se contemplan en la Ley de Nielsen, porque se refiere tan solo a los «usuarios avanzados». Y la Ley de Nielsen está estrechamente ligada a la Ley de Moore, que apunta a las mejoras tecnológicas, también, como una evolución exponencial. En el caso de Nielsen hablamos de un estudio sobre la velocidad de acceso a Internet a través de banda ancha fija según la experiencia propia.

La realidad es que no se duplica la velocidad cada dos años

Según la Ley de Wirth, el software evoluciona a mayor ritmo, en cuanto a su complejidad, que la velocidad de proceso del hardware en ordenadores de sobremesa. Con esta teoría se echa por tierra la afirmación en torno a la evolución exponencial de la tecnología sentada por Moore, que en ningún caso encaja con la realidad del acceso a Internet, sin un horizonte que deje como posible el crecimiento ilimitado de hogares con acceso. ¿Crece el porcentaje de hogares con acceso a Internet? Sí, pero no de forma exponencial. Ahora bien, también G. Moore apuntó a que «nada crece de forma indefinida sin que ocurra un desastre». Ahora bien, en este caso hablamos de tecnología, más concretamente de hardware, y no sólo de la correspondiente a la banda ancha.

La realidad, contrastada por las estadísticas que ofrecen, entre otros, la Comisión Nacional de los Mercados y la Competencia, es que lo enunciado por Nielsen no es cierto. No, la velocidad de Internet no está creciendo cada 21 meses, pero en el caso de algunos usuarios sí lo está haciendo incluso cada menos tiempo, concretamente cada 15 meses como demostró Andrés González Molina, ex directivo de Telefónica. Ahora bien, la diferencia es radical entre lo que ocurre y lo que puede ocurrir. Es decir, el ritmo de crecimiento real de la velocidad de acceso a Internet y el ritmo posible.

Pero sí se puede duplicar cada dos años: Cómo y por qué no ocurre

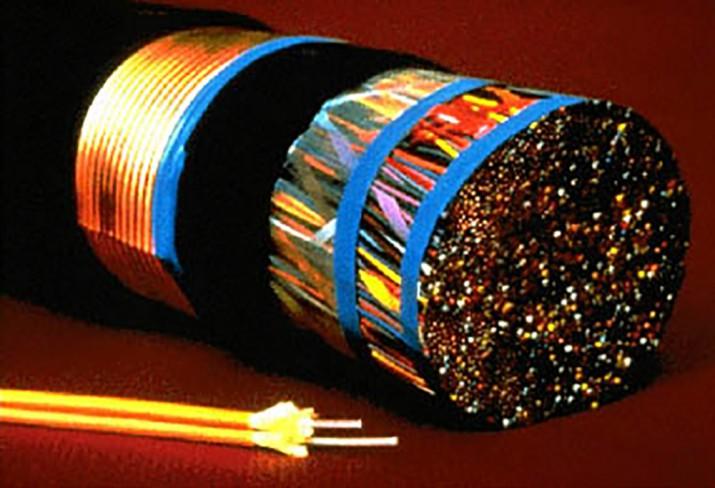

El ritmo de crecimiento de la velocidad de acceso a Internet depende de un factor fundamental, la tecnología empleada para la banda ancha fija. Y es que, justo en este punto, es donde retomamos lo enunciado por Moore en cuanto a las limitaciones de la tecnología, puesto que no son los mismos máximos de transferencia -descarga- para el cable que para la fibra óptica.

Por lo tanto, a grosso modo, los usuarios contemplados como «no avanzados» por Nielsen y su ley, esos que no experimentan una duplicación de la velocidad de acceso a Internet cada 21 meses, sufren una evolución tecnológica truncada por el despliegue de la tecnología que permite que se cumpla la Ley de Nielsen. Esa es la diferencia entre «lo que ocurre» y «lo que debería ocurrir». Centrándonos en un caso concreto y de actualidad, los clientes de Movistar Fusión van a ver cómo su velocidad no se duplica, sino que se triplica, pero ocurre porque la tecnología de acceso así lo permite.

Los límites impuestos actualmente, los que truncan el posible crecimiento según la Ley de Moore, tienen que ver con el ritmo de despliegue de la fibra óptica. Esta es la «tecnología del futuro» en cuanto a banda ancha fija, la única vía que sí permite, ahora mismo, duplicar la velocidad de acceso a Internet cada dos años. ¿Por qué? Porque el ADSL también tiene posibilidades, pero sus límites están más cerca que los de la fibra óptica.

¿Cuál es el límite teórico de la velocidad de Internet?

Una de las varias corrientes de opinión en torno a los límites de crecimiento en la velocidad de Internet sentencian que «el verdadero límite vendrá por la falta de necesidad de crecimiento». Las aplicaciones del ancho de banda son las que estimulan el crecimiento de la velocidad de acceso, y por lo tanto según esta teoría la velocidad dejaría de crecer tan pronto como deje de ser necesario. Ahora bien, actualmente vemos cómo se propone el streaming en 4K e incluso 8K y en gran cantidad de puntos, en el territorio nacional, no hay tecnología que lo soporte.

Por lo tanto, saliendo de esta postura, es interesante revisar cuáles son los límites, en cuanto a velocidad de transferencia, para la fibra óptica, que es la tecnología de banda ancha fija que se impone para el futuro. Actualmente existen modalidades de 10 Mb y hasta 1 Gbps, entre muchas otras opciones, pero, ¿hasta dónde podemos llegar con la fibra óptica? Abandonando, una vez más, la Ley de Moore y la Ley de Nielsen, los últimos estudios han conseguido alcanzar velocidades de entre 200 y 400 gigabits sobre fibra óptica. ¿Y por qué no llegamos aquí? Porque no sólo consiste en contemplar la velocidad a la que la luz puede viajar sobre la fibra óptica, sino cómo se transfiere también la misma información en las centrales de los proveedores de Internet.

¿Hacemos caso a la Ley de Nielsen? Si tomásemos sus afirmaciones como empíricamente ciertas, dentro de dos años algunos usuarios en España deberían estar navegando, al menos, con velocidades de descarga de 4 Gbps. Y sabiendo que no va a ocurrir así, que ojalá se cumpliese, más «gracioso» es pensar cuántos usuarios serían y qué hardware requerirían para disfrutar de esta conexión: HDD o SDD, procesadores y otros componentes cruciales para procesar datos a tal velocidad.